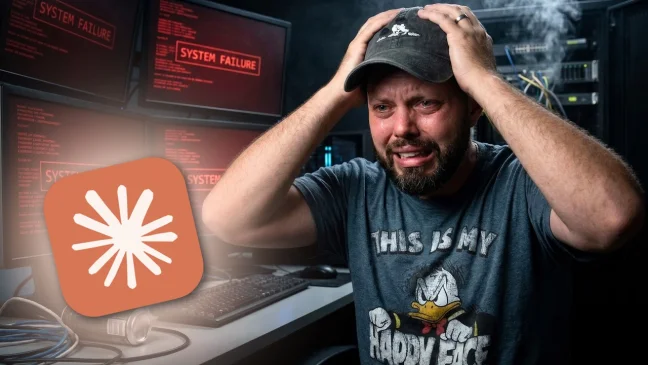

Cristian abre este episodio con una confesión dura: se casó con Anthropic y cuando Claude se cayó, no pudo trabajar. Un día entero improductivo porque decidió no usar su plan B. La conversación que sigue toca fibras sensibles — dependencia de LLMs, SLAs que nadie está midiendo, la filtración del código de Claude Code, el CEO de JP Morgan pidiendo regulación para “salvar la sociedad”, y por qué el cuello de botella de la IA seguimos siendo los humanos.

Lo que vas a aprender

- Cómo diseñar un plan de contingencia real cuando tu productividad depende de un LLM específico

- Por qué un SLA de 93,7% en tu proveedor crítico equivale a una semana laboral completa sin servicio al mes

- Qué pasó con la filtración del código de Claude Code y por qué la competencia acaba de recibir años de trabajo gratis

- Cómo leer la señal política de que un CEO de banco grande pida regulación post-despidos por IA

- Qué proyectos concretos están ejecutando los hosts esta semana y por qué pueden servirte de template

¿Qué hacer cuando tu LLM favorito se cae en medio del día laboral?

Tres capas de contingencia, listas antes de que las necesites. Primero, consumí el modelo desde una API alternativa (AWS Bedrock o Azure OpenAI Service para Anthropic) para que una caída directa del proveedor no te deje muerto. Segundo, definí qué tareas podés hacer a mano sin catástrofe y cuáles necesitan IA sí o sí. Tercero, mantené una segunda suscripción viva en otro proveedor (GPT, Gemini), aunque sea el plan básico, para tareas donde la calidad no es crítica y solo necesitás avanzar.

“Tomé la decisión a propósito de casarme con Anthropic. Tengo el plan de $200, Claude Code, Claude Cowork, OpenClaw. Ayer falló. El último mes se cayó como cinco veces.” — Cristian Tala

Rodrigo confirmó que le pasa lo mismo: la personalidad del modelo importa. Claude escribe distinto, resuelve distinto, tiene un estilo propio. Diego — que está usando MiniMax 2.7 para gastar menos tokens — fue el único que defendió la rotación pragmática entre modelos.

La lección operativa es más dura que la emocional: en ambientes productivos consume Claude por la API de AWS Bedrock o Azure, no directo de Anthropic. Mismo modelo, infraestructura distinta. Si se cae una, consumes de la otra.

¿Por qué un SLA de 99% ya no alcanza?

Porque el delta entre 93,7% y 99,9% son 44 horas laborales al mes. 99,9% SLA permite 43 minutos de downtime mensual; 93,7% equivale a 45 horas — una semana laboral completa sin servicio. GitHub cerró marzo exactamente en 93,7%. Si tu productividad depende de una herramienta con ese uptime, no sos productivo, sos rehén. Rodrigo lo lleva más lejos: hay empresas que colapsan cuando Notion se cae porque toda la lista de tareas vive ahí, sin Notion giran en círculo.

- 99,9% SLA permite 43 minutos de downtime mensual

- 93,7% SLA equivale a 45 horas de downtime

45 horas es una semana laboral completa. Si tu productividad depende de una herramienta con ese uptime, no eres productivo: eres rehén. Rodrigo llevó el punto más lejos: hay empresas que colapsan cuando Notion se cae. No es que la herramienta ejecute trabajo; es que toda la lista de tareas vive ahí. Sin Notion, giran en círculo.

“Estos son sistemas que te multiplican, pero uno debería ser capaz de hacer su pega solo.” — Rodrigo Rojo

La filtración del código de Claude Code: ¿error o jugada de marketing?

El giro del episodio. Hace dos días Anthropic publicó todo el código fuente del cliente de Claude Code — no el modelo, pero sí el arnés con el que se conducía — porque alguien lo sacó del .gitignore. En horas la comunidad descubrió:

- 44 funcionalidades ocultas detrás de feature flags

- Una llamada Kairos: agente autónomo de largo plazo

- Clones en Rust ya publicados en Twitter

- Un archivo interno con una lista enorme de palabras inventadas (

flavorgusting, etc.) que aparecen mientras Claude “piensa”

Lo más raro: Anthropic no se ha pronunciado. Los propios desarrolladores del equipo Claude están reaccionando orgullosos a lo que se encontró, en lugar de pedir que bajen los repos. Diego especuló con una posible jugada de marketing previa a un IPO. Rodrigo lo dejó abierto: dado que pasó, mejor aprovechar el momento.

En paralelo se filtraron rumores de dos modelos: Claude Maitos y Claude Capibara, supuestamente más potentes que Opus. Coincidencia sospechosa.

En la misma ventana de noticias, Qwen lanzó Qwen 3.5 Omni con capacidades de audio nativo — un recordatorio de que la frontera de modelos no se detiene mientras Anthropic arregla su infraestructura.

¿OpenClaw local, GenSpark Cloud o NemoClaw de NVIDIA?

Para quienes están cansados de pelear con errores de OpenClaw instalado a pulso, aparecieron dos alternativas empresariales que vale la pena nombrar:

GenSpark Cloud — Diego lleva varias semanas usándolo y es el único OpenClaw suyo que “no se ha muerto”. El arnés que GenSpark monta encima hace que el modelo se comporte mejor. El trade-off: no eliges todos los modelos, pero tampoco peleas con API keys ni credenciales.

NemoClaw de NVIDIA — Rodrigo lo resumió así: es OpenClaw con corbata y maletín. Mismo código por debajo, pero con ambiente Docker privado, hardware validado, capas de seguridad enterprise. “Le pone trajecito para que pueda ir a la oficina sin que nadie hable de problemas de seguridad.” NVIDIA entró como patrocinador oficial del proyecto OpenClaw.

El contrapunto crítico también salió: las últimas actualizaciones de OpenClaw endurecieron tanto los permisos que rompieron flujos que funcionaban hace dos semanas. Rodrigo tuvo que reinstalar su setup; el flujo Readwise → Reader → Obsidian que tenía armado dejó de poder crear archivos. Trabajar en tecnología experimental implica aceptar que cada release puede romperte algo.

¿Es sensato pedir regulación para “salvar la sociedad”?

Depende de si leés la jugada con generosidad o con cinismo. La lectura caritativa: el CEO de JP Morgan, después de despedir gente por IA, busca moderar la velocidad del cambio y evitar caos social. La lectura cínica: ya capturó las ganancias de la automatización y ahora quiere frenar a la competencia que aún no lo hizo. Rodrigo recuerda la carta de 2023 de Musk y Harari pidiendo pausar IA: no pasó nada, el campo aceleró. El código abierto está suelto; la política no marca el ritmo, la frontera técnica sí.

Cristian lo leyó con generosidad: quizás es un llamado a moderar la velocidad del cambio y evitar caos social. Rodrigo fue más duro. Recordó la carta de 2023 firmada por Elon Musk, Yuval Noah Harari y otros científicos pidiendo pausar el desarrollo de IA — no pasó nada, el campo aceleró más que nunca.

“El camino no es frenar esto. Es cómo hago para que la sociedad sepa navegar en este nuevo mundo. Si alguien quisiera hacer el mal, el código abierto ya está suelto. Un computador potente en una cabaña con un pendrive puede correrlo.” — Rodrigo Rojo

La segunda parte del debate fue más local: en redes sociales los hosts están recibiendo hate de gente que niega cosas que están públicamente documentadas (“estás mintiendo”, “esto es falso”). Las fuentes están en el post. La resistencia no es racional; es supervivencia psicológica.

¿En qué están trabajando los hosts esta semana?

Cada uno cerró con un proyecto concreto. Vale la pena listarlos porque son casos de uso reales, no teóricos:

Cristian — Mantiene Anthropic como modelo prioritario y levantó un servidor Git espejo en su VPS con Docker para no depender de GitHub. Redundancia de infraestructura para la capa que más le dolió.

Rodrigo — “Vector Rodrigo”: documentar en Obsidian (archivos Markdown puros, lo que más le gusta a la IA) quién es, sus proyectos, cursos, herramientas, preferencias, frameworks que le gustan, reglas de negocio internalizadas. Todo en formato consumible por agente. Además, usa QMD — la herramienta de Tobi Lütke (CEO de Shopify) — para búsqueda vectorial local sobre esos archivos. En paralelo está haciendo auditoría de tools: qué está pagando que ya no usa. Ya llegó dos veces al límite de tokens de su cuenta Max de Claude este mes.

Diego — MiniMax 2.7 como modelo principal para ahorrar tokens. Lanzó un blog nuevo, empresasaumentadas.com, para documentar cómo las empresas están implementando IA. Y para Revenue Summit está armando un experimento: tres agentes compitiendo para generar leads, con reglas claras y un ranking público de desempeño.

¿Cuál es la frase que resume este episodio?

Rodrigo citó a Andrej Karpathy (ex-Tesla, OpenAI), en una entrevista reciente:

“El cuello de botella hoy somos los humanos. La IA está esperando que le digamos ‘sigue’ o ‘haz esto’. Pero nosotros tenemos que dormir.” — Andrej Karpathy, citado por Rodrigo Rojo

La implicancia práctica: hoy tienes todo para armar cosas. La pregunta ya no es “¿puedo?”, es “¿qué quiero probar?”. Y hacerlo rápido, con más o menos riesgo según tu contexto.

Preguntas frecuentes

¿Cómo diseño un plan de contingencia si mi agente depende de Claude?

Tres capas: primero, consume el modelo desde una API alternativa (AWS Bedrock o Azure OpenAI Service para Anthropic) para que una caída de Anthropic directa no te deje muerto. Segundo, define qué tareas puedes hacer a mano sin catástrofe y cuáles necesitan IA sí o sí. Tercero, ten una segunda suscripción viva en otro proveedor (GPT, Gemini) aunque sea el plan básico, para tareas donde la calidad no es crítica y solo necesitas avanzar.

¿Qué es Kairos en el código filtrado de Claude Code?

Es una de las 44 funcionalidades que Anthropic tenía detrás de feature flags y que se filtraron junto con el resto del código cliente. Está descrita como un agente autónomo de largo plazo — la jugada que la comunidad interpretó como la dirección final de Claude Code hacia operación sin supervisión continua. No está disponible públicamente; solo existe en el repo filtrado.

¿Qué diferencia hay entre OpenClaw, GenSpark Cloud y NemoClaw?

OpenClaw es el framework base, open source, que instalas en tu VPS o computador. GenSpark Cloud lo empaqueta como servicio: pagas un fee mensual, ellos corren el agente, eliminas la fricción del terminal pero pierdes control total. NemoClaw es la versión de NVIDIA: mismo OpenClaw por debajo más capas de seguridad enterprise, Docker privado y hardware validado — pensado para corporaciones que necesitan compliance.

¿Por qué el CEO de JP Morgan pide regulación después de despedir gente por IA?

La lectura caritativa es que busca moderar la velocidad del cambio para evitar caos social. La lectura cínica es que ya capturó las ganancias de la automatización y ahora quiere frenar la competencia que aún no lo hizo. Históricamente, este tipo de declaraciones (como la carta de Musk y Harari en 2023) no han frenado el campo: el código abierto está suelto y el ritmo lo marca la frontera técnica, no la política.

Recursos mencionados

🌐 eslahoradeaprender.com · 🎧 Spotify · 📺 YouTube

Accesibilidad: activa los subtítulos en el reproductor de YouTube para leer la conversación completa.